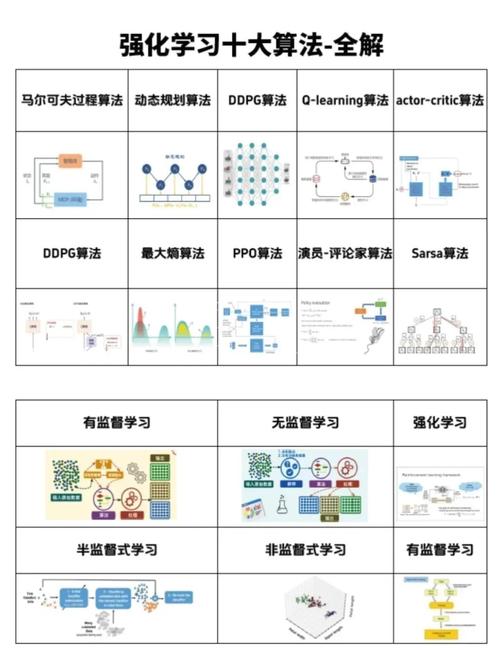

DQN的基本概念

DQN(Deep Q-Network)是一种基于深度学习的强化学习算法,主要用于在复杂环境(如游戏、机器人控制等)中寻找最优策略,与传统的Q-Learning相比,DQN通过引入深度神经网络来缓解状态空间的爆炸式增长,从而在处理高维度状态时表现出色。

DQN的基本框架

环境建模

DQN的核心依赖于对环境状态的建模,状态通常是高维和离散的,因此需要通过某种方式将其转换为可处理的表示形式,在游戏环境中,每个状态可以表示为玩家的动作序列,而每个动作可以进一步转换为一个向量。

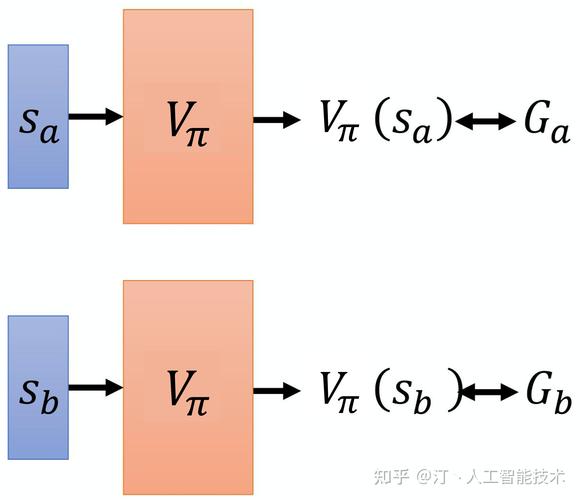

Q-Network

Q-Network是一种神经网络,用于估计状态转移到下一个状态的最优期望奖励,DQN通过训练Q-Network以适应环境,从而实现Q学习的收敛。

转变器(Transformer)

DQN引入了Transformer架构来处理序列数据,Transformer通过双注意力机制将输入序列转换为更高效的表示形式,解决了传统RNN在长序列上的性能不足问题,Transformer还能够处理无监督学习,这在强化学习中非常有用。

Bellman等式

Bellman等式是强化学习的核心方程,描述了价值函数与奖励之间的关系,在DQN中,价值函数通过训练DQN来估计状态的价值,从而实现最优策略的寻找。

DQN的实现细节

环境模拟与数据集

为了训练DQN,需要先实现一个模拟环境,环境模拟器如Gym(OpenAI Gym)可以提供标准的环境数据集,包括动作、奖励和状态转移等信息。

神经网络结构设计

DQN的神经网络需要设计得精确,以适应环境状态和动作的特性,神经网络包括输入层、隐藏层(用于处理高维状态)和输出层(用于估计Q值)。

梯度计算与优化

DQN通过最小化经验对( Experience Loss)来优化Q-Network,使用梯度下降或Adam优化算法来更新网络参数,为了加快收敛速度,可以采用双随机梯度下降(Double Q-learning)等方法。

模型评估与实验

为了评估DQN的性能,需要设计有效的模型评估指标,如Q值的平均误差、标准差等,通过在不同环境中测试DQN的性能,可以比较不同算法的优劣。

DQN的优缺点

优点

- 高效:通过Transformer架构,DQN能够处理复杂的序列数据。

- 适应性:DQN可以适应高维状态空间,如游戏环境。

- 稳定:通过双随机梯度下降,DQN能够更稳定地找到最优策略。

缺点

- 计算复杂度高:DQN需要训练大量参数,计算资源要求较高。

- 参数选择重要:DQN的性能很大程度上取决于神经网络的参数数量和结构设计。

- 依赖于数据:DQN的性能依赖于良好的数据集和数据预处理。

随着深度学习技术的不断进步,DQN有望在更多领域中发挥作用,DQN可以用于自动驾驶、智能助手等高智能体任务中,随着Transformer架构的进一步优化,DQN的性能有望进一步提升。